オンライン面接でのAI不正利用を検出するAIツール3選

オンライン面接の普及と生成AI技術の進化に伴い、採用プロセスにおける不正行為はますます巧妙化している。主な不正行為には、履歴書の誇張や偽のプロフィールを用いた「経歴詐称」、面接中にAI支援ツールを使用して回答を得る「カンニング」、他人が代わりに面接を受ける「替え玉面接」などが含まれる。近年では、ディープフェイク技術を用いて顔や声をリアルタイムに合成し、架空の人物が面接を受ける「なりすまし」も報告されている。

AI不正利用の実情

2025年4月、米国のプロフェッショナル向け匿名コミュニティアプリ「Blind」が3617人のユーザーを対象に実施した調査によると、20%が「面接中にAIツールを隠れて使用した」と回答している。また、55%が「面接におけるAI支援は新たなニューノーマルになっている」と認識している(※1)。

さらに、2025年3月にResume Genius が米国のハイアリングマネジャー1000 人を対象に行った調査では、約17%が「ディープフェイク技術を使用した求職者をビデオ面接した経験がある」と回答している。加えて、76% が「AI の影響により、求職者が本物かどうかの判断が困難になる」と考えていることが明らかとなった(※2)。

オンライン面接での回答を支援する求職者向けAIツールの増加

不正の増加原因の1つとして、求職者向けのAIツールの存在が挙げられる。たとえば、Cluely(旧Interview Coder)はエンジニア向けのオンライン面接支援ツールであり、面接中にAIが画面上のコーディング課題や音声を解析し、求職者に対して回答を提示する仕組みを備えている。このツールは、画面上に透明なインターフェースを重ねて回答を表示するため、面接官が画面共有を求めた場合でも不正の発見が困難となる構造となっている。「プロ」プラン(利用無制限)の月間利用料は20ドルである。

このほか、米国ではFinal Round AI や360Interview AI、Sensei AI、Verve AIなど、オンライン面接での回答を支援する同様のツールが次々と登場している。

対面面接への回帰と不正検知技術の進化

オンライン面接における不正行為への対策として、対面面接へ回帰する動きが一部企業の間で見られている。Deloitte UKは、2024年9月より新卒採用において対面面接を再開した。この措置は、英国の会計監督機関であるFinancial Reporting Council(FRC)が、「完全オンライン型の採用プロセスには不正のリスクがある」と警告したことを受けたものである(※3)。また、Googleもエンジニア職の採用において対面面接の再導入を検討していると一部で報じられている(※4)。

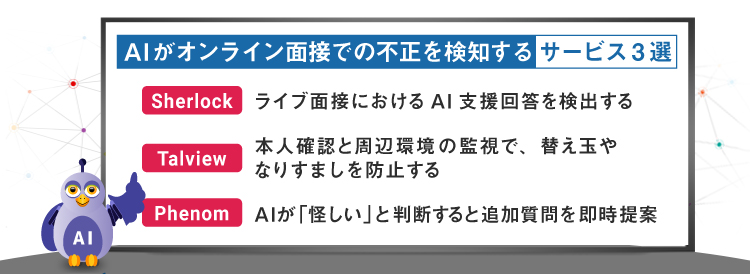

こうした状況に対応するかたちで、不正検知機能を備えたHRテクノロジーが次々と登場している。本コラムでは、特にオンライン面接における不正行為に焦点を当て、それに対処するAIツール「Sherlock」「Talview」「Phenom」を紹介する。これら3つのツールは、映像・音声・行動パターンをリアルタイムで分析し、不正行為の兆候を検出する機能を備えている。Sherlockは主にAIによる回答支援の検出に特化しており、Talviewは替え玉面接や環境に関する不正の排除を重視している。Phenomは面接中に不正の可能性が検出された場合、AIが自動的に追加質問を提案し、面接官にその場での対応を促す “半自律型エージェント”を搭載している点が特徴である。

Sherlock:ライブ面接におけるAI支援回答を検出する

Sherlockは、2025年4月にWeCP(We Create Problems)が発表したAI搭載の面接監視ツールである。Cluelyなどの求職者向けAI支援ツールに対抗する目的で開発されており、実際にCluelyが生成したコーディング回答の検出に成功している。

このツールは、Zoom、Microsoft Teams、Google Meetなどの主要な面接プラットフォームとシームレスに連携し、以下の3つの分析機能を組み合わせることで、オンライン面接中の不正行為を検出する。

- 映像分析

カメラ映像を通じて、目線の動き、唇の動きと音声の同期、画面外の視線移動、複数の顔の存在などを検出する。 - 音声分析

マイク音声から、応答の遅延、機械的な話し方、ささやき声など、外部からの音声支援の兆候を識別する。 - 行動分析

キーボードの入力パターン、応答のタイミング、ブラウザの挙動などを解析し、AIツールの使用やスクリプトの読み上げといった不自然な行動を特定する。

不正の証拠映像を含むレポート機能

Sherlockは、疑わしい行動が検出された際、単にアラートを発するだけでなく、何が起きたのかを具体的に示す詳細なレポートを提供する。映像による不正の証拠や、求職者の行動パターンが記録されるため、面接官は不正の有無について自信を持って判断することが可能である。

2000社超の導入実績

Sherlockは、Meta、Tesla、Infosys、Adobe、Texas Instruments、Capgeminiなど2000社を超える企業に導入されている。月額利用料は240ドルからとなっている。

Talview:本人確認と周辺環境の物理的監視で替え玉やなりすましを防止する

Talviewは、インド発のAIプロクタリング(監視・監督)プラットフォームであり、オンライン面接や試験における不正防止を目的に開発している。

面接前の本人認証と環境確認

面接開始前に、求職者は自撮り写真や身分証明書の画像をTalviewのアプリにアップロードすると、事前に登録された本人データとの照合が行われる。加えて、求職者がカメラを用いて自室の360度環境スキャン(机の上、部屋の四隅、天井、床など)を実施すると、TalviewのAIが不正なデバイスや資料、第三者の存在を自動的に検出する。

面接中のリアルタイム監視

Talviewは、面接中に映像と音声を本人の登録データと常時照合するだけでなく、以下のような手段を用いてリアルタイムでの監視と異常検知を行っている。

- 画面外の視線や不審な操作の検知

目線の動きやキーボード操作に異常が見られた場合、自動的にフラグが立てられる。 - セカンダリカメラ(2台目の監視カメラ)

求職者に、スマートフォンやタブレットに専用アプリをインストールさせ、自身の横や後方に設置させることで、PCのメインカメラでは映らない手元や周囲の様子を監視し、カンニングや代行者の存在を検出する。 - ライブ画面の共有

面接中にPC画面を共有させることで、ほかのアプリやブラウザの不正利用をリアルタイムで監視する。

【本人認証の機能】映像と音声分析で、なりすましを特定する。

【本人認証の機能】映像と音声分析で、なりすましを特定する。

出所:Talview提供 https://www.talview.com/en/candidate-verification

面接中の行動パターンの分析

求職者の発言の間に生じる長い沈黙や、発言内容の不自然な変化などをAIが詳細に分析し、不正の兆候や違和感のある受け答えを検出する。

120カ国での導入実績

Talviewは、Allianz、Cognizant、Meta、Cisco、Nvidia、Shopify、Vodafone、MetLife、Best Buyなどの大手企業により、120カ国で利用されている。インドのIT企業HCLTechでは、Talviewを導入してから7カ月間で10人のなりすましを特定し、面接前に阻止することができた。これにより、採用プロセスの信頼性が向上し、採用担当者の業務負荷も軽減された(※5)。

Phenom:不正の兆候に応じて深掘り質問を提案するエージェント型AIツール

2025年5月、採用・タレントマネジメントプラットフォームのPhenomは、オンライン面接における不正行為をリアルタイムで検出するエージェント型AIツール「Fraud Detection Agents」を発表した。2025年6月には一部の顧客企業においてベータテストを開始し、同年末には一般提供が予定されている。

ライブ面接中の生成AIによる回答の検出と深掘り質問の生成

ライブのビデオ面接において、求職者の回答はリアルタイムで記録・解析される。ChatGPTやClaudeなどの生成AIが利用されている可能性を検出し、不正の兆候が認められた場合には、面接官に即時アラートを送信する。加えて、AIが求職者の経験やスキルに関する追加の質問を提案し、面接官による追加質問を支援する。

シミュレーションテストへの対応

Phenomは、実務スキルを測定するシミュレーションテストにも対応しており、回答までの時間やタイミング、内容の一貫性をAIが分析する。事前に用意されたスクリプトや生成AIによる回答の使用を示す兆候を検出するほか、行動パターン全体を通じて通常の求職者と異なる挙動がないかを総合的に判断する。

企業に求められる対応と視点

業務に必要なスキルを持たない求職者が不正行為を通じて採用された場合、企業はチーム全体の生産性の低下、セキュリティリスク、採用・育成にかかるコストの増加、さらに企業の評判低下といったリスクを負うことになる。

AIによる不正検出ツールは、こうしたリスクへの対応として有効ではあるが、導入するだけですべての不正を防げるわけではない。顔認証技術には誤検知の可能性があり、プライバシーの懸念や人種などに起因する差別のリスクも存在する。また、求職者に対して心理的な圧迫感を与える可能性も考慮すべきである。

不正行為の防止は当然の課題であるが、AIの活用を一律に排除する姿勢には慎重な検討が求められる。近年では、社内でAIを使いこなすスキルを人事評価に反映する動きが広がりつつあり、「AIによる面接支援を受けながら回答する行為を“不正”とみなすのか、それとも“AI活用力”と評価するのか?」という線引きは企業によって異なる。

たとえばAmazonは、2025年初頭より、面接中にChatGPTなどの生成AIツールを使用しないことを求職者に誓約させ、違反した場合は選考から除外するというガイドラインを導入した。さらに、面接中のAIツール利用を検出するシステムを2025年中に実装する予定であると報じられている(※6)。

一方Claudeを開発するAnthropicは、同年2月までは応募時のAI利用を全面的に禁止していたが、5月になって方針を大きく見直した。今後の面接プロセスでは、求職者のAIの活用能力を重視すると同時に、「AIにどのような指示を与えたのか?それの目的は何か?」「AIの回答を基に指示をどのように調整したか?」「AIの限界をどのように認識しているか?」といった活用プロセスを評価対象にするという(※7)。

今後、求職者によるAI活用の増加と、それを支援するツールの高度化が進むなかで、企業はAIツールの使用をどこまで許容するか/制限するかという方針を明確化するだけでなく、「どう使ったか」を評価する面接の設計が求められている。

TEXT=杉田真樹

(※1)https://www.teamblind.com/blog/1-in-5-u-s-professionals-secretly-use-ai-during-job-interviews/

(※2)https://resumegenius.com/blog/job-hunting/ai-impact-on-hiring

(※3)https://www.ft.com/content/65aeba60-f149-4b72-a834-91c63f092a78?utm_source=chatgpt.com

(※4)https://www.cnbc.com/2025/03/09/google-ai-interview-coder-cheat.html

(※5)https://www.talview.com/resources/case-studies/hcl-tech-prevent-candidate-impersonation?utm_source=chatgpt.com

(※6)https://www.businessinsider.com/amazon-stop-people-using-ai-cheat-job-interviews-2025-2

(※7)https://opentools.ai/news/anthropic-embraces-ai-in-job-interviews-claude-ais-role-as-ethical-overseer?utm_source=chatgpt.com

メールマガジン登録

メールマガジン登録 各種お問い合わせ

各種お問い合わせ