AIで変わるHRの役割

企業の82%がAI使用禁止を検討

職場での業務にAIを利用する労働者が増えているが、フランスではその利用方法が問題視されている。仏全国人事労務管理責任者協会(ANDRH)の調査(※1)では、68%の労働者が「生成AIを仕事に利用したことを上司に隠している」という結果を公表しており興味深い。誰もが情報に簡単にアクセスできる手軽さとその即効性から、生成AIに頼りすぎて、自分で考えることを放棄する傾向があることも問題視されている。

BlackBerryの調査(※2)によると、仏企業の82%が、「従業員が日常的に利用している業務用デバイスから、ChatGPTなどの生成AIの削除を検討している」という。その主な理由は、利用ルールが整備されていない段階では、情報の正当性に疑念が残ること、また企業の機密情報の漏洩などのリスクがあるためだ。Mazarsフランス支社の人事部長であるマチルド・ル=コズ氏は「安全性や利用規定が確立されるまでは、従業員の利用を禁止する」と宣告し、これに続く企業も多い。

欧州におけるAIのHRへのインパクトの専門家であるHEC(※3)の名誉教授のシャルル=アンリ・ベセイユ・デ・オー博士は、欧州企業は従業員の生成AIの利用に対する規制を強める傾向にあるが、「オフィス外での利用も含め、生成AIの利用を中断する人はいない、規制を強めても普及が止まることはない」と断言する。

仏政府、フランス人が作った生成AIに期待

一方、サービスの一環として組織的に生成AIを導入するケースもある(※4)。公共サービスの利用者により迅速かつ効果的なサービスを提供することを目的に、政府が一部の職員の業務に生成AIを実験的に導入したケースがある。この実験は、CNIL(※5)の協力を得て市民が当局と交換するデータの機密性を考慮し実行している。政府機関では既に顧客対応業務以外にもAIが使われていることにも言及し、あくまでも職員の「補助的役割」としての活用を強調している。

2023年10月から6カ月のテスト期間後、2024年4月に全国的導入が検討される。ゲリニ公共変革・公務員大臣は、AIによる職員の代替が目的ではないことを前提に、「職員がAIのオーナーシップを持ち、業務のツールとして利用するには、その使い方をきちんと学ぶ必要がある」と語る。試験導入を開始するにあたり、政府は当初200人の「AIボランティア職員」を募ったが、最終的に1000人に膨れ上がり、AIへの期待が顕著となった。

今回のAI試験導入では、ChatGPT以外に、フランス人が作った生成AI「Bloom」に注目が集まっている。「Bloom」はフランス人3人が米ニューヨークで立ち上げた、AIのオープンソース・プラットフォームであるHugging Face(※6)による生成AIである。ChatGPTは英語で構築しているが、これは基礎の段階から46カ国語で構築されており、自動翻訳などを介入させずに直接それぞれの言語で抽出される。将来的にChatGPTに代わるサービスとして、フランス全土で大きな期待を寄せ注目している。

AIで変わるHRの役割

従業員の生成AIの無断使用に対する規制が広まる一方、企業が組織運営の目的でAIを利用するケースは増えている。特にHR部門におけるAI利用は顕著である。

ロレアルのHRデータ&アナリティクス オフィサーのローラン・レイッシュ氏は、生成AIを「統計ツールとして、さまざまな業種で活用すべきだ」と言う。ロレアルでは、データを新しいアイデアやインスパイアを与えるツールとみなし、従業員のパフォーマンスとエンゲージメント向上のために活用している。具体的には、全社員を対象とした年2回の個別面談システムを改善・廃止して、HRとの日常的な「会話」をデータ収集プロセスとして構築し、HR戦略を考案する際の足場としている。

エールフランスでHRイノベーション・シニア・アドバイザーとして活躍するアンヌ・グレジュビーヌ氏は、「生成AIによって、HRの役割は大きな変革期を迎えている」と語る。同社のHRでは、全ての「ライティング」作業を生成AIが実行し、全体で何時間の節約につながり、パフォーマンス向上に役立ったかを分析している。

また、同社ではAIによってアウトソーシングからインソーシングの動きが進んでおり、社員研修は外部機関が介入せずに行われるようになりつつある。一方、生成AIからの的確な情報抽出には6カ月間が必要という。有益な情報を引き出すには質問方法にもコツがあり、ツールを使いこなす必要があるからだ。グレジュビーヌ氏は「AIと競争するのではなく、お互いに成長しようとする、協業の精神を持つことが成功の秘訣」と締めくくる。

HRを待ち構える新たな局面

生成AIの従業員による社内使用が公式に認められるようになると、HRの役割がこれまで以上に重要になってくる。たとえば、生成AIを効率よく活用するための「倫理憲章」や「行動規範」の作成や、社内研修の実施、機密情報の管理、著作権への対応などが必要となる。また、生成AIの過度な利用から、従業員が依存やバーンアウトに陥るリスクも指摘されている。こうした新しい側面に向き合うための準備が必要だ。

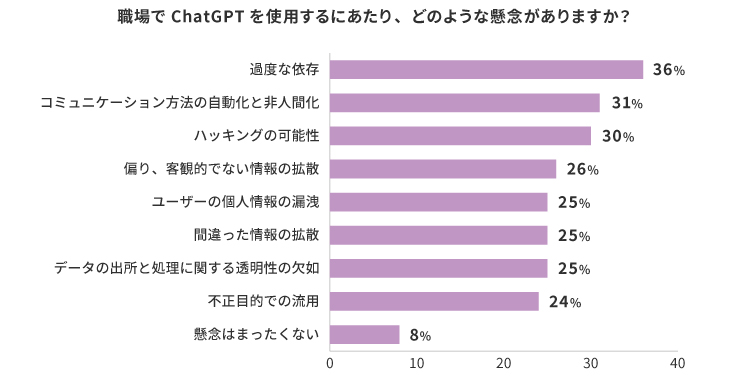

AIツールへの過度な依存の可能性が表面化したのは、2023年のGetApp(※7)によるアンケート調査からだ(※8)。調査対象の36%が、「AIツールへの過度な依存の可能性を懸念している」と回答している。ツールへの依存度が高まると、自身で考えて行動するという思考プロセスが奪われ、結果AIに主体性を奪われてしまう危険があるという。

「人間力・知性」が試される時代へ

「サイバーセキュリティに関連するリスク同様、AI依存などを含めた危険性についても、従業員への教育を徹底しなければならない。AIの有用性は、人間による管理と検証をもってのみ保証される」と、ル=コズ氏は説明する。

オリジナルのチャットボットを作れる「GPTs」や、販売ができる「GPT Store」がローンチされるなど、凄まじいスピードでAI分野は進化している。現段階では、就職面接時にAIのスキルを問われるケースはまだ少ないが、個々のAIリテラシーのレベルはソフトスキルの1つとして、今後重要な判断事項となることは間違いない。AIリテラシーに関して、11月に開催されたフランス最大のHRカンファレンスでは、いたるところで「職業人としての成熟度」という表現を耳にした。AIの台頭に直面し試されているのは「人間力や知性」であり、それがAIにおける真の課題なのではないだろうか。

(※1)https://www.andrh.fr/article/memo-andrh-intelligence-artificielle-generative-quels-enjeux-rh

(※2)https://comarketing-news.fr/chatgpt-nest-pas-le-bienvenu-dans-les-entreprises-francaises/

(※3)高等商業学校(ビジネススクール)

(※4)https://www.leparisien.fr/high-tech/chatgpt-bloom-ladministration-va-tester-lia-des-septembre-pour-repondre-aux-questions-des-usagers-11-05-2023-2KEU32F3BVEALHW3BEVKZLAMDM.php

(※5)フランスの個人情報保護機関

(※6)https://huggingface.co/

(※7)アプリケーションのオンラインレビューサイトの大手 : https://www.getapp.fr/

(※8)https://www.getapp.fr/blog/4094/les-risques-de-l-intelligence-artificielle-generative-pour-les-entreprises

TEXT=田中美紀(客員研究員)

メールマガジン登録

メールマガジン登録 各種お問い合わせ

各種お問い合わせ